Nvidia的NeMo项目已经在半导体芯片设计中展示了生成式人工智能(AI)的巨大潜力。在一项最新的研究中,Nvidia的半导体工程师们展示了如何利用生成式AI来改进半导体芯片的设计过程。

这项研究表明,特定领域的专业人士可以通过使用内部数据训练的大型语言模型(LLMs),创建能够提高生产力的助手。Nvidia的NeMo项目通过定制化AI模型的应用,突出了在半导体领域获得竞争优势的潜力。

半导体设计是一个极具挑战性的任务,涉及到在3D电路图上精心构建包含数十亿晶体管的芯片,这些电路图就像城市街道一样,但比人的头发还要薄。这需要多个工程团队在数年的时间内协同工作,每个团队都专注于芯片设计的不同方面,使用特定的方法、软件程序和计算机语言。

Nvidia的芯片设计师们找到了一种方法,让大型语言模型(LLMs)协助他们创建半导体芯片。这项研究的首席作者Mark Ren表示:“我相信随着时间的推移,大型语言模型将帮助各个环节的工作。”

这篇研究论文在旧金山举行的计算机辅助设计国际会议上由Nvidia的首席科学家Bill Dally宣布。Dally表示:“这个工作标志着将LLMs应用于复杂的半导体设计工作的重要第一步。它展示了即使是高度专业化的领域也可以使用内部数据来训练有用的生成式AI模型。”

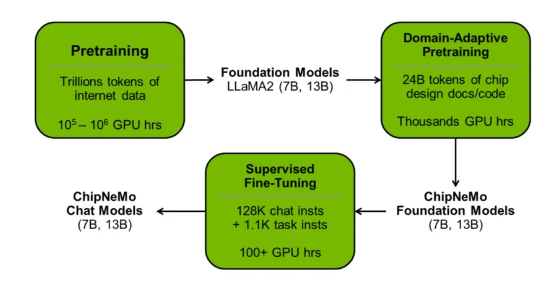

Nvidia的研究团队开发了一个名为ChipNeMo的定制LLM,它是通过公司的内部数据训练的,用于生成和优化软件,协助人工设计师。其长期目标是将生成式AI应用于芯片设计的每个阶段,从而大幅提高整体生产力。团队目前正在探讨的初步应用包括聊天机器人、代码生成器和分析工具。

其中最受欢迎的应用之一是分析工具,它自动化了维护更新的错误描述这一耗时任务。此外,还有一个原型聊天机器人,可以帮助工程师快速找到技术文档,以及一个代码生成器,用于创建专用软件的片段,用于芯片设计。

这项研究论文侧重于团队努力收集设计数据和创建专业生成式AI模型的过程,这一过程可以应用于任何行业。团队首先使用基础模型,并使用Nvidia NeMo,一个用于构建、定制和部署生成式AI模型的框架,来完善模型。最终的ChipNeMo模型拥有430亿参数,并经过了超过1万亿token的训练,展示了其理解模式的能力。

半导体行业才刚刚开始探索生成式AI的可能性,而这项研究提供了宝贵的见解。企业有兴趣构建自己的定制LLMs可以利用Nemo框架,该框架可以在GitHub和Nvidia NGC目录上获得。

首页

首页

资讯

资讯

下载

下载  我的

我的